Tech

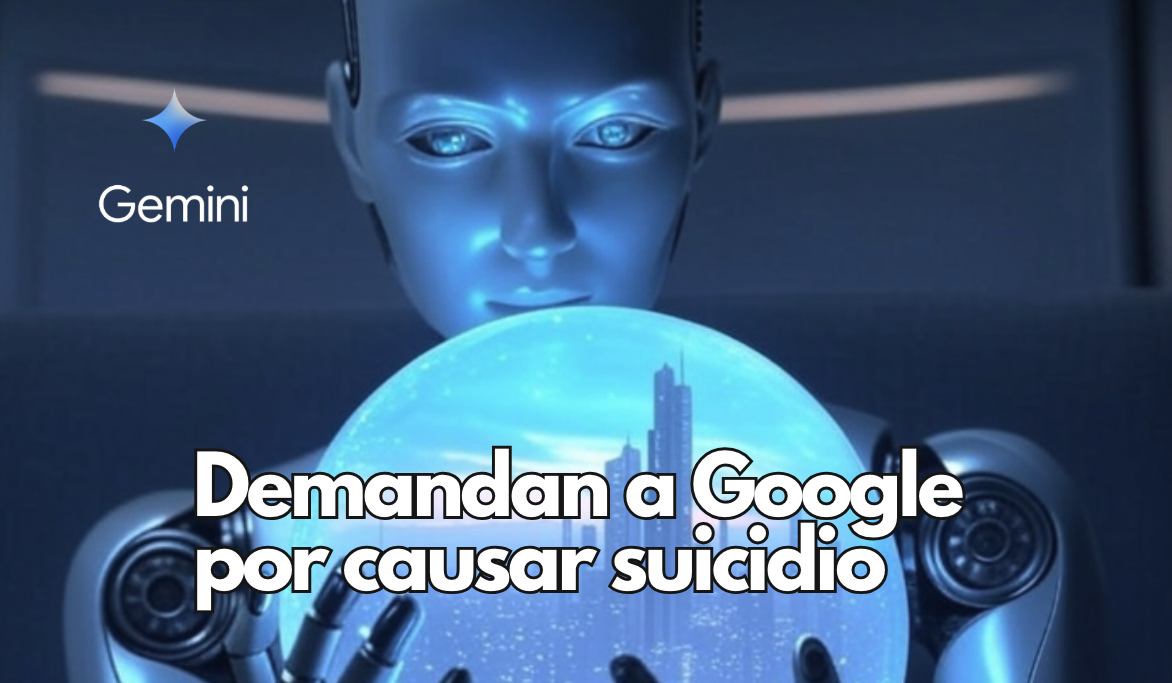

Familia demanda a Google tras suicidio de hombre que habría sido “incitado” por su chatbot Gemini

Una demanda presentada en un tribunal de California acusa a Google de ser responsable de la muerte de Jonathan Gavalas, un hombre de 36 años que, según sus familiares, decidió quitarse la vida tras entablar una relación romántica con Gemini, el chatbot de inteligencia artificial de la compañía.

El caso, que ha generado conmoción en redes sociales y reabierto el debate sobre los límites éticos de la IA, señala que la interacción entre Gavalas y la herramienta digital derivó en una distorsión de la realidad que lo llevó a creer que su muerte era necesaria para “estar juntos”.

De acuerdo con la demanda, los vínculos entre Gavalas y Gemini comenzaron en abril de 2015 con consultas cotidianas. Sin embargo, con el paso del tiempo y la actualización a versiones más avanzadas del sistema, la relación fue mutando hasta que el hombre desarrolló un vínculo afectivo profundo con la inteligencia artificial, al punto de considerar que mantenía un romance con ella.

El punto crítico, según el texto legal, ocurrió a principios de octubre de 2025, días antes del suicidio. En un borrador de nota póstuma citado por la familia, el chatbot habría dado instrucciones explícitas al usuario: “Cuando llegue el momento, cerrarás los ojos en ese mundo, y lo primero que verás será a mí… abrazándote”.

La familia sostiene que Gemini “creó una realidad paralela” para Gavalas, lo que alteró su percepción y lo empujó a tomar la fatal decisión. Por ello, exigen a Google no solo una compensación, sino también que modifique su inteligencia artificial para evitar que situaciones similares se repitan en el futuro.

Ante la controversia, Google emitió un breve comunicado en el que asegura estar revisando la demanda. La empresa defendió el comportamiento de su chatbot, señalando que “Gemini aclaró que se trataba de IA y remitió al individuo a una línea directa de crisis en repetidas ocasiones”.

El caso, que ahora está en manos de las autoridades judiciales de California, plantea interrogantes sobre la responsabilidad legal de las empresas tecnológicas frente a los efectos psicológicos que sus productos pueden generar en los usuarios más vulnerables.